L’utilisation d’un logiciel de reconnaissance faciale a conduit la police de Détroit à arrêter à tort Porcha Woodruff, 32 ans, pour vol et détournement de voiture, rapporte le New York Times. Enceinte de huit mois, elle a été détenue pendant 11 heures, interrogée et son iPhone a été saisi comme preuve avant d’être relâchée. Il s’agit de la dernière d’une série de fausses arrestations dues à l’utilisation de la technologie de reconnaissance faciale, que de nombreux détracteurs jugent peu fiable.

Sommaire

- 1 Les Détails de l’Erreur

- 2 Le Déroulement de l’Incident

- 3 Les Suites Judiciaires

- 4 Statistiques et Cas Similaires

- 5 La Question du Biais Racial

- 6 La Fiabilité Contestée de la Reconnaissance Faciale

- 7 Les Risques Inhérents à la Technologie

- 8 Analyses et Rapports sur la Technologie

- 9 Les Sources des Erreurs

- 10 Les Réactions et Changements Politiques

- 11 Les Répercussions sur la Vie de Mme Woodruff

Les Détails de l’Erreur

L’erreur est d’autant plus remarquable que les images de surveillance utilisées pour identifier à tort Mme Woodruff ne montraient pas de femme enceinte, alors que cette dernière était visiblement enceinte au moment de son arrestation.

Le Déroulement de l’Incident

L’incident a commencé par une recherche automatisée de reconnaissance faciale par la police de Détroit. Un homme cambriolé a signalé le crime et la police a utilisé DataWorks Plus pour comparer les séquences vidéo de surveillance à une base de données de photos d’identité de criminels. La photo d’identité judiciaire de Woodruff, prise en 2015 lors d’une précédente arrestation sans rapport avec l’affaire, a été identifiée comme correspondant à la photo.

Les Suites Judiciaires

Woodruff a été inculpée de vol et de car-jacking avant d’être libérée contre une caution personnelle de 100 000 dollars. Un mois plus tard, les charges retenues contre elle ont été abandonnées par le procureur du comté de Wayne. Woodruff a intenté un procès pour arrestation injustifiée contre la ville de Detroit, et le chef de la police de Detroit, James E. White, a déclaré que les allégations étaient préoccupantes et que l’affaire était prise au sérieux.

Statistiques et Cas Similaires

Selon le New York Times, cet incident est le sixième cas récent où une personne a été accusée à tort en raison de la technologie de reconnaissance faciale utilisée par la police, et le troisième à se produire à Détroit. Les six personnes accusées à tort étaient toutes noires.

La Question du Biais Racial

La ville de Détroit fait actuellement l’objet de trois procès liés à des arrestations injustifiées fondées sur l’utilisation de la technologie de reconnaissance faciale. Des groupes de défense, dont l’Union américaine pour les libertés civiles du Michigan, demandent que davantage de preuves soient recueillies dans les affaires impliquant des fouilles au faciès automatisées, et que l’on mette fin aux pratiques qui ont conduit à de fausses arrestations.

La Fiabilité Contestée de la Reconnaissance Faciale

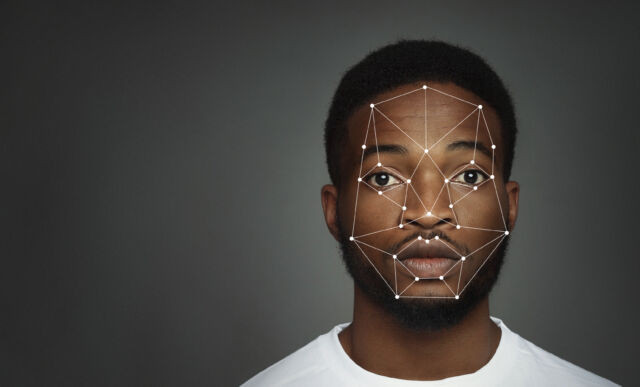

« La fiabilité de la reconnaissance des visages… n’a pas encore été établie ». Des études ont montré que les technologies de reconnaissance faciale existantes sont plus susceptibles de générer des faux positifs avec les visages noirs.

Les Risques Inhérents à la Technologie

L’arrestation de M. Woodruff et la récente tendance aux fausses arrestations ont relancé le débat sur la fiabilité de la technologie de reconnaissance faciale dans les enquêtes criminelles. Les critiques affirment que cette tendance met en évidence les faiblesses de la technologie de reconnaissance faciale et les risques qu’elle fait courir à des personnes innocentes.

Analyses et Rapports sur la Technologie

Un rapport de 2022 de Georgetown Law sur l’utilisation de la reconnaissance faciale dans le cadre de l’application de la loi a conclu que la fiabilité de cette technologie n’a pas encore été établie. Des rapports supplémentaires indiquent également des problèmes liés au biais humain, à la qualité des preuves et à la technologie sous-performante.

Les Sources des Erreurs

La faible précision de la technologie de reconnaissance faciale provient de plusieurs sources, notamment d’algorithmes non éprouvés, de biais dans les ensembles de données d’entraînement, et de qualité médiocre des images.

Les Réactions et Changements Politiques

Ces problèmes ont conduit certaines villes à interdire son utilisation, notamment San Francisco, Oakland et Boston. Cependant, certaines villes commencent à reconsidérer cette interdiction.

Les Répercussions sur la Vie de Mme Woodruff

Quant à Mme Woodruff, elle a été hospitalisée pour déshydratation et profondément traumatisée. Son avocat, Ivan L. Land, a insisté sur la nécessité pour la police de mener des enquêtes plus approfondies, plutôt que de se fier uniquement à la technologie.